Como usar uma janela de buffer de conversa no LangChain?

A janela do buffer de conversação é usada para manter as mensagens mais recentes da conversa na memória para obter o contexto mais recente. Ele usa o valor de K para armazenar as mensagens ou strings na memória usando a estrutura LangChain.

Para aprender o processo de uso da janela do buffer de conversa no LangChain, basta seguir o seguinte guia:

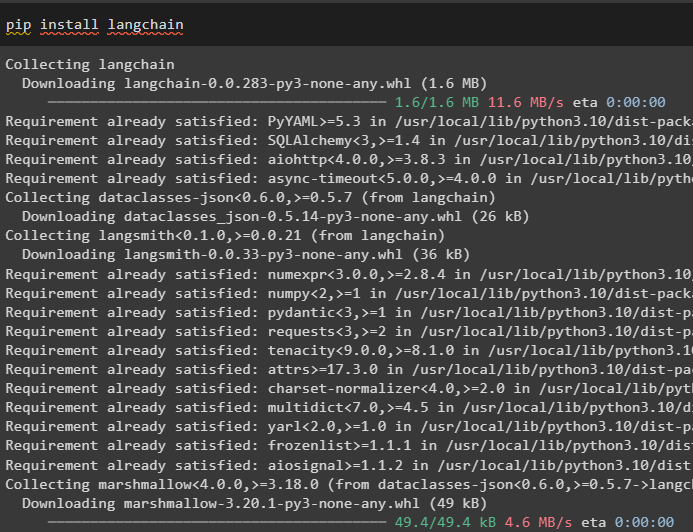

Etapa 1: instalar módulos

Inicie o processo de utilização da janela do buffer de conversação instalando o módulo LangChain com as dependências necessárias para construir modelos de conversação:

pip instalar langchain

Depois disso, instale o módulo OpenAI que pode ser usado para construir os modelos de linguagem grande em LangChain:

pip instalar openai

Agora, configurar o ambiente OpenAI para construir as cadeias LLM usando a chave API da conta OpenAI:

importar os

importar Obter passagem

os . aproximadamente [ 'OPENAI_API_KEY' ] = Obter passagem . Obter passagem ( 'Chave de API OpenAI:' )

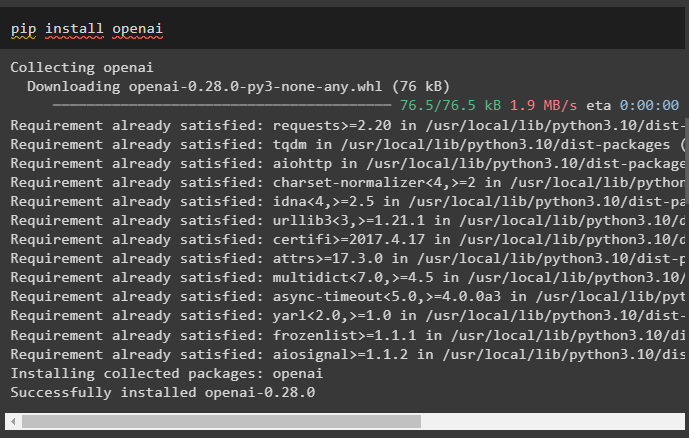

Etapa 2: usando a memória da janela do buffer de conversa

Para usar a memória da janela do buffer de conversação no LangChain, importe o ConversationBufferWindowMemory biblioteca:

de cadeia longa. memória importar ConversationBufferWindowMemoryConfigure a memória usando o ConversationBufferWindowMemory () método com o valor de k como argumento. O valor de k será usado para manter as mensagens mais recentes da conversa e então configurar os dados de treinamento usando as variáveis de entrada e saída:

memória = ConversationBufferWindowMemory ( k = 1 )memória. salvar_contexto ( { 'entrada' : 'olá' } , { 'saída' : 'Como vai' } )

memória. salvar_contexto ( { 'entrada' : 'Eu estou bem e você' } , { 'saída' : 'não muito' } )

Teste a memória chamando o carregar_memória_variáveis () método para iniciar a conversa:

memória. carregar_memória_variáveis ( { } )

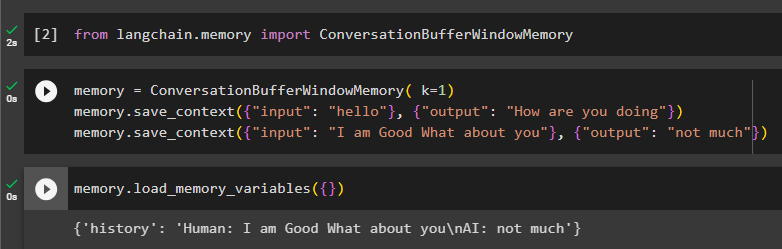

Para obter o histórico da conversa, configure a função ConversationBufferWindowMemory() usando o mensagens_retornadas argumento:

memória = ConversationBufferWindowMemory ( k = 1 , mensagens_retornadas = Verdadeiro )memória. salvar_contexto ( { 'entrada' : 'oi' } , { 'saída' : 'e aí' } )

memória. salvar_contexto ( { 'entrada' : 'não muito você' } , { 'saída' : 'não muito' } )

Agora, chame a memória usando o carregar_memória_variáveis () método para obter a resposta com o histórico da conversa:

memória. carregar_memória_variáveis ( { } )

Etapa 3: usando a janela do buffer em uma cadeia

Construa a cadeia usando o OpenAI e Cadeia de conversação bibliotecas e depois configure a memória buffer para armazenar as mensagens mais recentes da conversa:

de cadeia longa. correntes importar Cadeia de conversaçãode cadeia longa. llms importar OpenAI

#building resumo da conversa usando vários parâmetros

conversa_com_resumo = Cadeia de conversação (

llm = OpenAI ( temperatura = 0 ) ,

#construindo buffer de memória usando sua função com o valor k para armazenar mensagens recentes

memória = ConversationBufferWindowMemory ( k = 2 ) ,

#configure a variável detalhada para obter uma saída mais legível

detalhado = Verdadeiro

)

conversa_com_resumo. prever ( entrada = 'Oi, e ai' )

Agora continue a conversa fazendo a pergunta relacionada à saída fornecida pelo modelo:

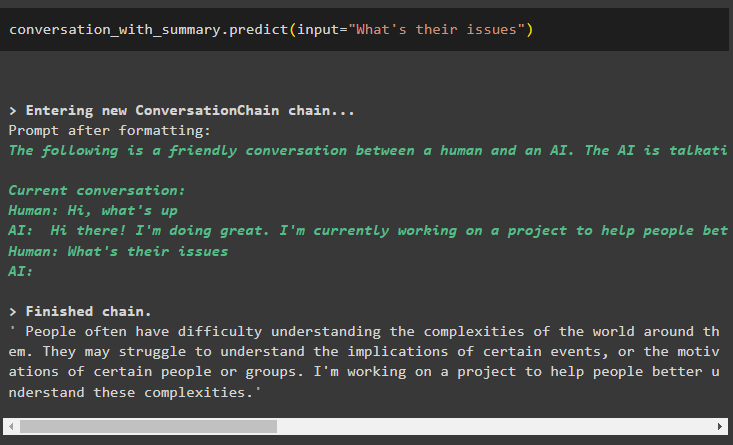

conversa_com_resumo. prever ( entrada = 'Quais são os problemas deles' )

O modelo está configurado para armazenar apenas uma mensagem anterior que pode ser usada como contexto:

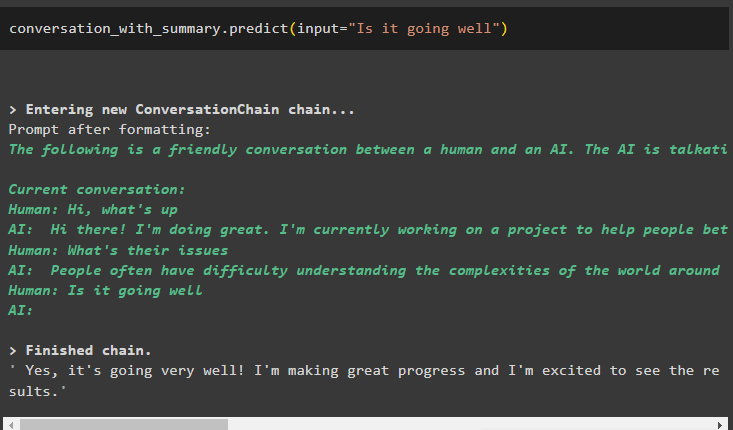

conversa_com_resumo. prever ( entrada = 'Está indo bem' )

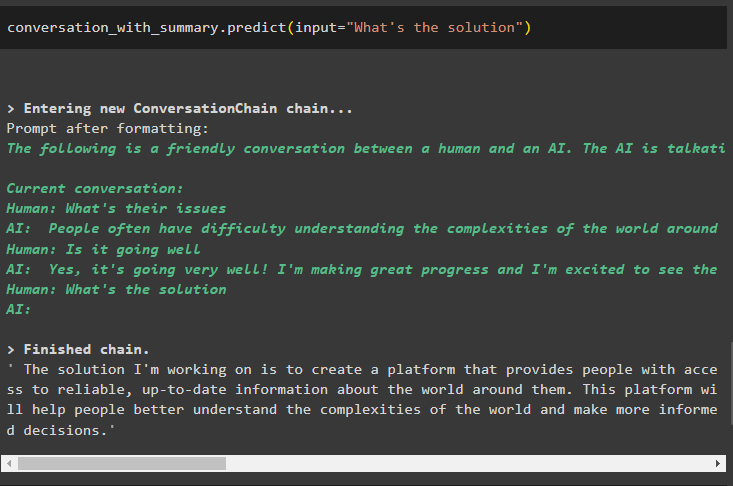

Peça a solução para os problemas e a estrutura de saída continuará deslizando a janela do buffer removendo as mensagens anteriores:

conversa_com_resumo. prever ( entrada = 'Qual é a solução' )

Isso é tudo sobre o processo de uso do LangChain do Windows buffer de conversa.

Conclusão

Para usar a memória da janela do buffer de conversação no LangChain, basta instalar os módulos e configurar o ambiente usando a chave API do OpenAI. Depois disso, construa a memória buffer usando o valor de k para manter as mensagens mais recentes da conversa e manter o contexto. A memória buffer também pode ser usada com cadeias para instigar a conversa com o LLM ou cadeia. Este guia elaborou o processo de uso da janela do buffer de conversa no LangChain.