Este artigo fornece um guia passo a passo sobre o uso de Tokenizers em Hugging Face Transformers.

O que é um tokenizador?

Tokenizer é um conceito importante da PNL e seu principal objetivo é traduzir o texto bruto em números. Existem diversas técnicas e metodologias presentes para esse fim. Porém, é importante ressaltar que cada técnica atende a um propósito específico.

Como usar tokenizadores em transformadores de rosto abraçado?

Como usar tokenizadores em transformadores de rosto abraçado?

A biblioteca tokenizer deve ser instalada primeiro antes de usá-la e importar funções dela. Depois disso, treine um modelo usando AutoTokenizer e forneça a entrada para realizar a tokenização.

Hugging Face apresenta três categorias principais de tokenização que são fornecidas abaixo:

- Tokenizer baseado em palavras

- Tokenizer baseado em caracteres

- Tokenizer baseado em subpalavras

Aqui está um guia passo a passo para usar Tokenizers em Transformers:

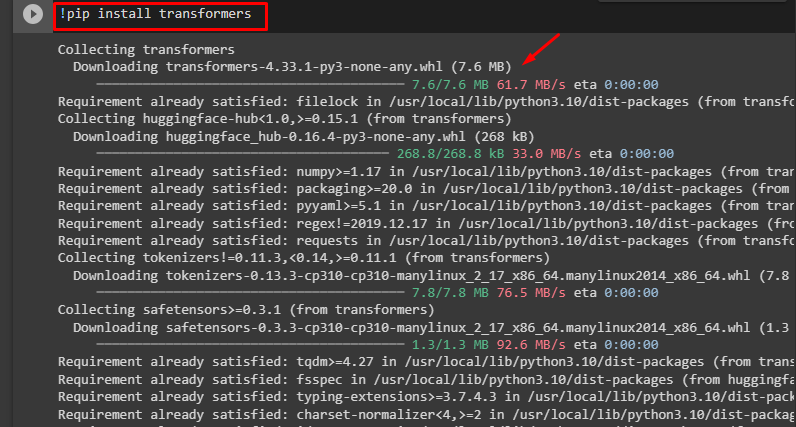

Etapa 1: instalar transformadores

Para instalar transformadores, use o comando pip no seguinte comando:

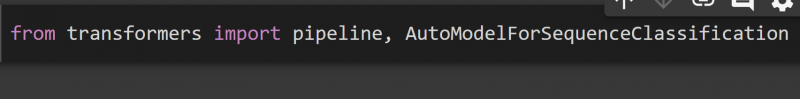

Etapa 2: importar classes

De transformadores, importe gasoduto , e AutoModelForSequenceClassification biblioteca para realizar a classificação:

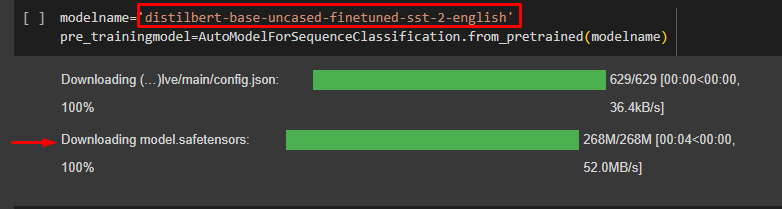

Etapa 3: importar modelo

O ' AutoModelForSequenceClassification ”É um método que pertence à Auto-Class para tokenização. O from_pretrained() O método é usado para retornar a classe de modelo correta com base no tipo de modelo.

Aqui fornecemos o nome do modelo no campo “ nome do modelo ' variável:

nome do modelo = 'distilbert-base-uncased-finetuned-sst-2-english'modelo de pré_treinamento =AutoModelForSequenceClassification.from_pretrained ( nome do modelo )

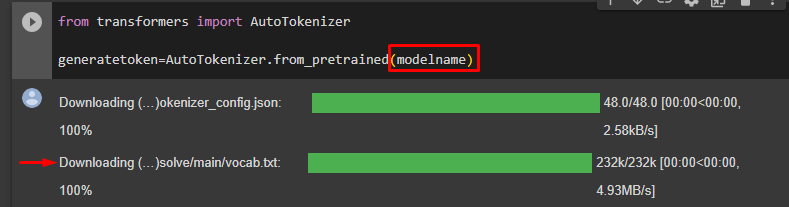

Etapa 4: importar o AutoTokenizer

Forneça o seguinte comando para gerar tokens passando o “ nome do modelo ”como o argumento:

o token gerado =AutoTokenizer.from_pretrained ( nome do modelo )

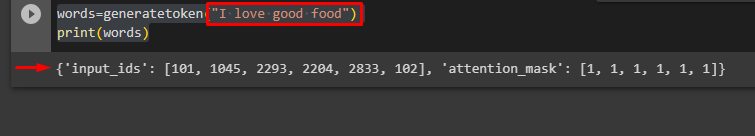

Etapa 5: gerar token

Agora, vamos gerar tokens em uma frase “Adoro boa comida” usando o “ o token gerado ' variável:

imprimir ( palavras )

A saída é dada da seguinte forma:

O código acima Google Co. é dado aqui.

Conclusão

Para usar Tokenizers no Hugging Face, instale a biblioteca usando o comando pip, treine um modelo usando AutoTokenizer e forneça a entrada para realizar a tokenização. Ao usar a tokenização, atribua pesos às palavras com base nos quais elas são sequenciadas para reter o significado da frase. Essa pontuação também determina seu valor para análise. Este artigo é um guia detalhado sobre como usar Tokenizers em Hugging Face Transformers.