LangChain é a estrutura com aplicação no domínio de Processamento de Linguagem Natural ou PNL para construir modelos em linguagens semelhantes às humanas. Esses modelos podem ser usados por humanos para obter respostas do modelo ou conversar como qualquer outro ser humano. LangChain é usado para construir cadeias, armazenando cada frase da conversa e interagindo ainda mais usando-a como contexto.

Esta postagem irá ilustrar o processo de construção de LLM e LLMChain em LangChain.

Como construir LLM e LLMChain em LangChain?

Para construir LLM e LLMChain em LangChain, basta seguir as etapas listadas:

Etapa 1: instalar módulos

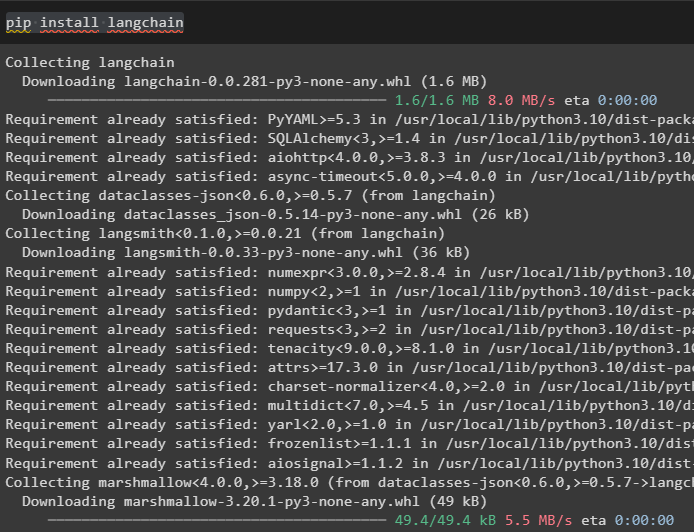

Primeiramente, instale o módulo LangChain para usar suas bibliotecas para construir LLMs e LLMChain:

pip instalar langchain

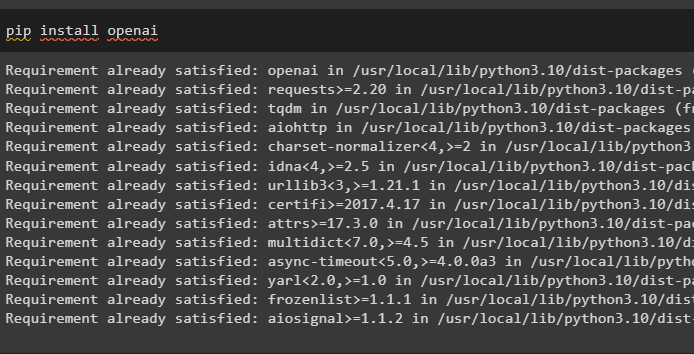

Outro módulo necessário para construir LLMs é o OpenAI e pode ser instalado usando o comando pip:

pip instalar openai

Etapa 2: configurar um ambiente

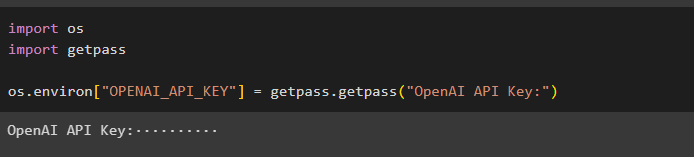

Configure um ambiente usando a chave de API OpenAI de seu ambiente:

importe-nosimportar getpassos.environ['OPENAI_API_KEY'] = getpass.getpass('Chave API OpenAI:')

Exemplo 1: Construir LLMs usando LangChain

O primeiro exemplo é construir grandes modelos de linguagem usando LangChain importando bibliotecas OpenAI e ChatOpenAI e usando a função llm():

Etapa 1: usando o modelo de bate-papo LLM

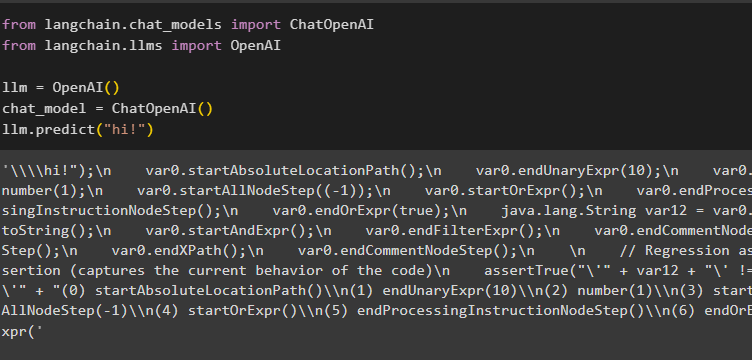

Importe módulos OpenAI e ChatOpenAI para construir um LLM simples usando o ambiente OpenAI do LangChain:

de langchain.chat_models importar ChatOpenAIde langchain.llms importar OpenAI

llm = OpenAI()

chat_model = ChatOpenAI()

llm.predict('oi!')

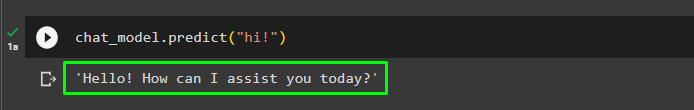

A modelo respondeu com a resposta “oi”, conforme exibido na imagem a seguir:

A função prever() do chat_model é usada para obter a resposta ou resposta do modelo:

chat_model.predict('oi!')A saída mostra que o modelo está à disposição do usuário que faz consultas:

Etapa 2: usando consulta de texto

O usuário também pode obter respostas do modelo fornecendo a frase completa na variável de texto:

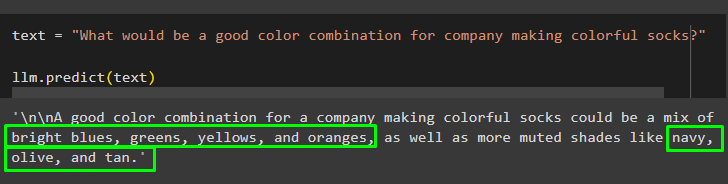

text = 'Qual seria um bom nome para uma empresa que fabrica meias coloridas?'llm.predict(texto)

A modelo exibiu múltiplas combinações de cores para meias coloridas:

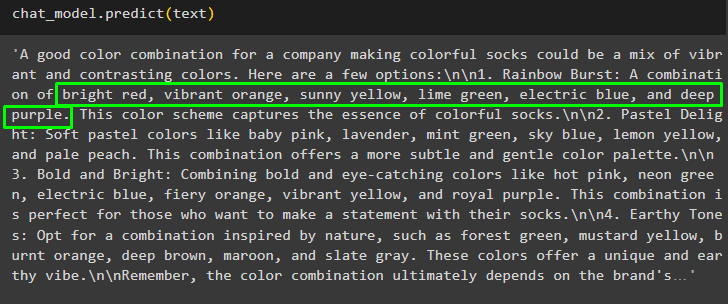

Obtenha a resposta detalhada do modelo usando a função predizer() com as combinações de cores das meias:

chat_model.predict(texto)

Etapa 3: usando texto com conteúdo

O usuário pode obter a resposta com uma pequena explicação sobre a resposta:

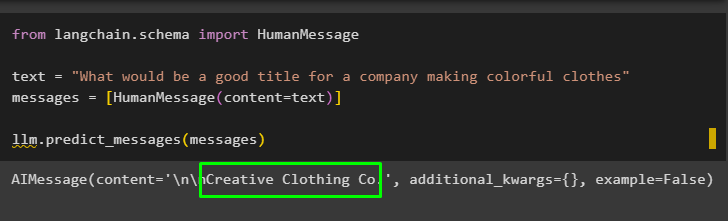

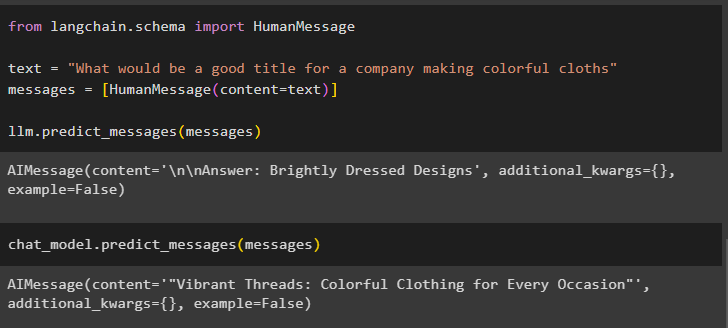

de langchain.schema importar HumanMessagetext = 'Qual seria um bom título para uma empresa que fabrica roupas coloridas'

mensagens = [MensagemHumana(conteúdo=texto)]

llm.predict_messages(mensagens)

A modelo gerou o título para a empresa que é “Creative Clothing Co”:

Preveja a mensagem para obter a resposta para o título da empresa com sua explicação também:

chat_model.predict_messages(mensagens)

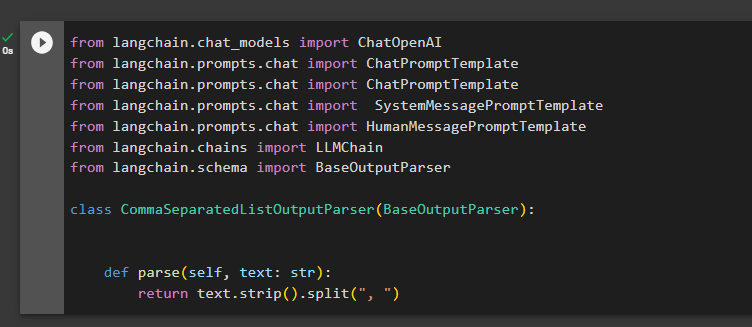

Exemplo 2: Construir LLMChain usando LangChain

O segundo exemplo do nosso guia constrói o LLMChain para obter o modelo no formato de interação humana para combinar todas as etapas do exemplo anterior:

de langchain.chat_models importar ChatOpenAIde langchain.prompts.chat importar ChatPromptTemplate

de langchain.prompts.chat importar ChatPromptTemplate

de langchain.prompts.chat importar SystemMessagePromptTemplatede langchain.prompts.chat importar HumanMessagePromptTemplate

de langchain.chains importar LLMChain

de langchain.schema importar BaseOutputParserclass CommaSeparatedListOutputParser (BaseOutputParser):

def analisar(self, texto: str):

retornar texto.strip().split(', ')

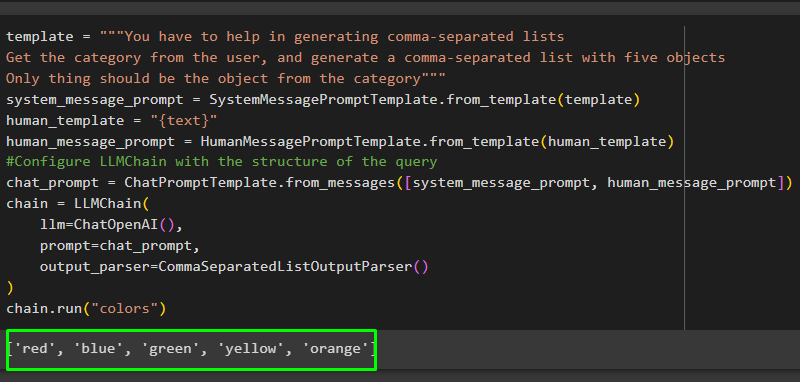

Construa o modelo para o modelo de chat fornecendo uma explicação detalhada de seu funcionamento e, em seguida, construa a função LLMChain() contendo o LLM, o analisador de saída e as bibliotecas chat_prompt:

template = '''Você tem que ajudar na geração de listas separadas por vírgulaObtenha a categoria do usuário e gere uma lista separada por vírgulas com cinco objetos

A única coisa que deve ser o objeto da categoria'''

system_message_prompt = SystemMessagePromptTemplate.from_template(modelo)

human_template = '{texto}'

human_message_prompt = HumanMessagePromptTemplate.from_template(human_template)

#Configure LLMChain com a estrutura da consulta

chat_prompt = ChatPromptTemplate.from_messages([system_message_prompt, human_message_prompt])

cadeia = LLMChain(

llm=ChatOpenAI(),

prompt=chat_prompt,

output_parser=CommaSeparatedListOutputParser()

)

chain.run('cores')

A modelo forneceu a resposta com a lista de cores, pois a categoria deve conter apenas 5 objetos fornecidos no prompt:

Trata-se de construir o LLM e o LLMChain no LangChain.

Conclusão

Para construir o LLM e LLMChain usando LangChain, basta instalar os módulos LangChain e OpenAI para configurar um ambiente usando sua chave API. Depois disso, construa o modelo LLM usando chat_model após criar o modelo de prompt para uma única consulta para um chat completo. LLMChain são usados para construir cadeias de todas as observações na conversa e usá-las como contexto da interação. Esta postagem ilustra o processo de construção de LLM e LLMChain usando a estrutura LangChain.