Este guia ilustrará o processo de uso de um resumo de conversa no LangChain.

Como usar o resumo da conversa no LangChain?

LangChain fornece bibliotecas como ConversationSummaryMemory que podem extrair o resumo completo do chat ou conversa. Ele pode ser utilizado para obter as principais informações da conversa sem a necessidade de ler todas as mensagens e textos disponíveis no chat.

Para aprender o processo de uso do resumo da conversa no LangChain, basta seguir as seguintes etapas:

Etapa 1: instalar módulos

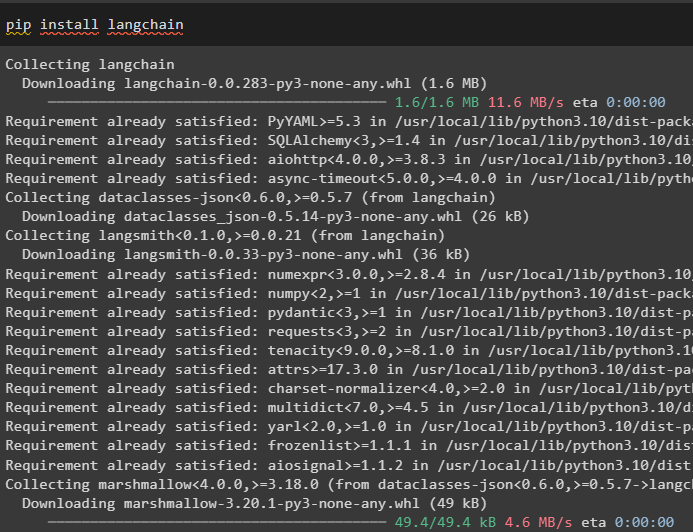

Primeiro, instale a estrutura LangChain para obter suas dependências ou bibliotecas usando o seguinte código:

pip instalar langchain

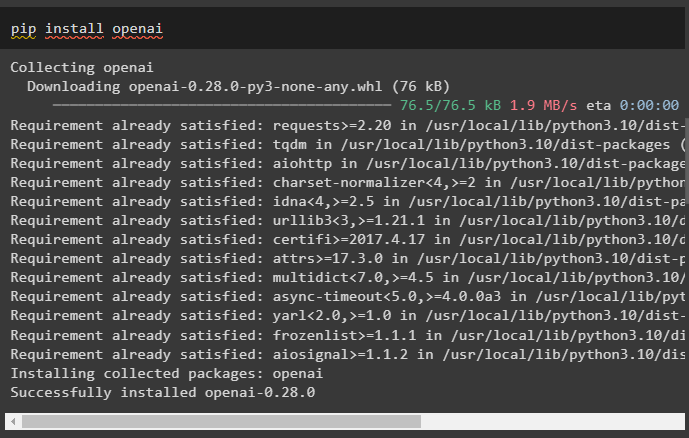

Agora, instale os módulos OpenAI após instalar o LangChain usando o comando pip:

pip instalar openai

Depois de instalar os módulos, basta configurar o ambiente usando o seguinte código após obter a chave API da conta OpenAI:

importar osimportar Obter passagem

os . aproximadamente [ 'OPENAI_API_KEY' ] = Obter passagem . Obter passagem ( 'Chave de API OpenAI:' )

Etapa 2: usando o resumo da conversa

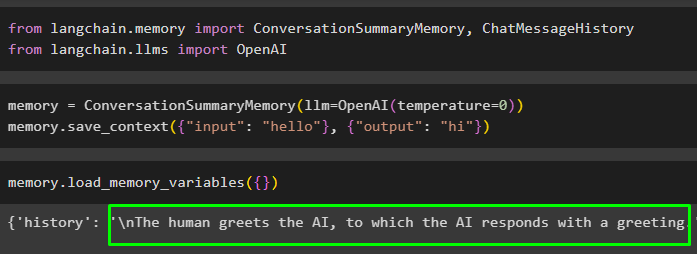

Entre no processo de uso do resumo da conversa importando as bibliotecas do LangChain:

de cadeia longa. memória importar ConversaResumoMemória , Histórico de mensagens de bate-papode cadeia longa. llms importar OpenAI

Configure a memória do modelo usando os métodos ConversationSummaryMemory() e OpenAI() e salve os dados nele:

memória = ConversaResumoMemória ( llm = OpenAI ( temperatura = 0 ) )memória. salvar_contexto ( { 'entrada' : 'olá' } , { 'saída' : 'oi' } )

Execute a memória chamando o carregar_memória_variáveis() método para extrair os dados da memória:

memória. carregar_memória_variáveis ( { } )

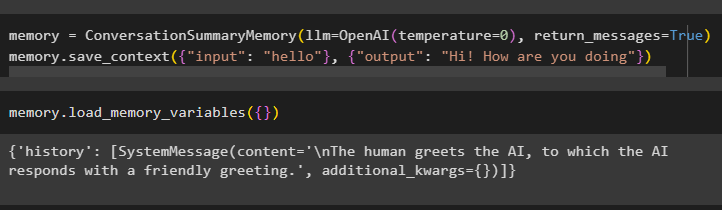

O usuário também pode obter os dados em forma de conversa como cada entidade com uma mensagem separada:

memória = ConversaResumoMemória ( llm = OpenAI ( temperatura = 0 ) , mensagens_retornadas = Verdadeiro )memória. salvar_contexto ( { 'entrada' : 'olá' } , { 'saída' : 'Oi Como vai você' } )

Para obter a mensagem da IA e dos humanos separadamente, execute o método load_memory_variables():

memória. carregar_memória_variáveis ( { } )

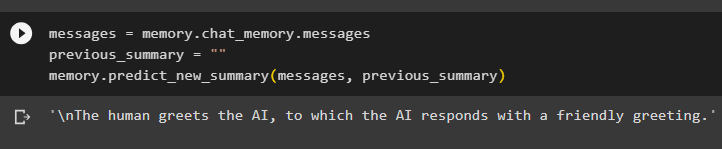

Armazene o resumo da conversa na memória e depois execute a memória para exibir o resumo do chat/conversa na tela:

mensagens = memória. chat_memory . mensagensresumo_anterior = ''

memória. prever_novo_resumo ( mensagens , resumo_anterior )

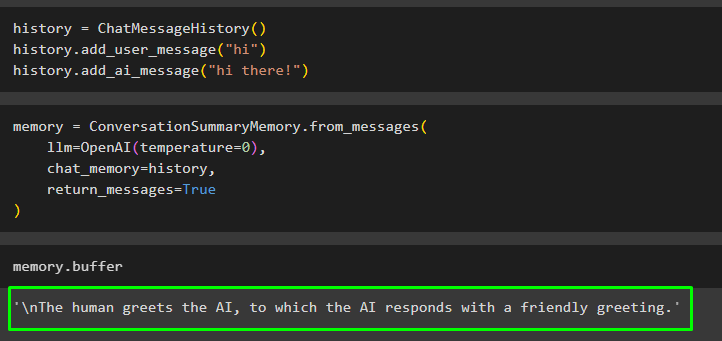

Etapa 3: usar o resumo da conversa com mensagens existentes

O usuário também pode obter o resumo da conversa que existe fora da aula ou chat usando a mensagem ChatMessageHistory(). Essas mensagens podem ser adicionadas à memória para gerar automaticamente o resumo da conversa completa:

história = Histórico de mensagens de bate-papo ( )história. add_user_message ( 'oi' )

história. add_ai_message ( 'olá!' )

Construa o modelo como LLM usando o método OpenAI() para executar as mensagens existentes no chat_memory variável:

memória = ConversaResumoMemória. de_mensagens (llm = OpenAI ( temperatura = 0 ) ,

chat_memory = história ,

mensagens_retornadas = Verdadeiro

)

Execute a memória usando o buffer para obter o resumo das mensagens existentes:

memória. amortecedor

Execute o seguinte código para construir o LLM configurando a memória buffer usando as mensagens de chat:

memória = ConversaResumoMemória (llm = OpenAI ( temperatura = 0 ) ,

amortecedor = '''O humano pergunta à máquina sobre si mesmo

O sistema responde que a IA foi construída para o bem, pois pode ajudar os humanos a atingir seu potencial''' ,

chat_memory = história ,

mensagens_retornadas = Verdadeiro

)

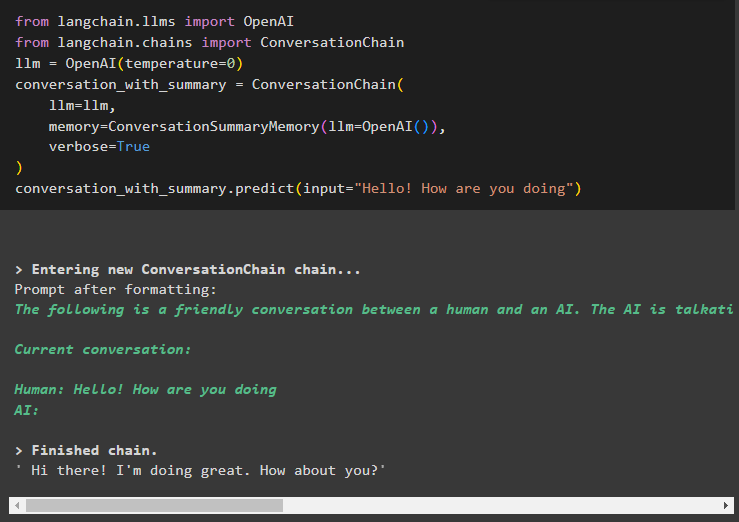

Etapa 4: usando o resumo da conversa em cadeia

A próxima etapa explica o processo de uso do resumo da conversa em uma cadeia usando o LLM:

de cadeia longa. llms importar OpenAIde cadeia longa. correntes importar Cadeia de conversação

llm = OpenAI ( temperatura = 0 )

conversa_com_resumo = Cadeia de conversação (

llm = llm ,

memória = ConversaResumoMemória ( llm = OpenAI ( ) ) ,

detalhado = Verdadeiro

)

conversa_com_resumo. prever ( entrada = 'Olá, como você está' )

Aqui começamos a construir cadeias iniciando a conversa com uma pergunta cortês:

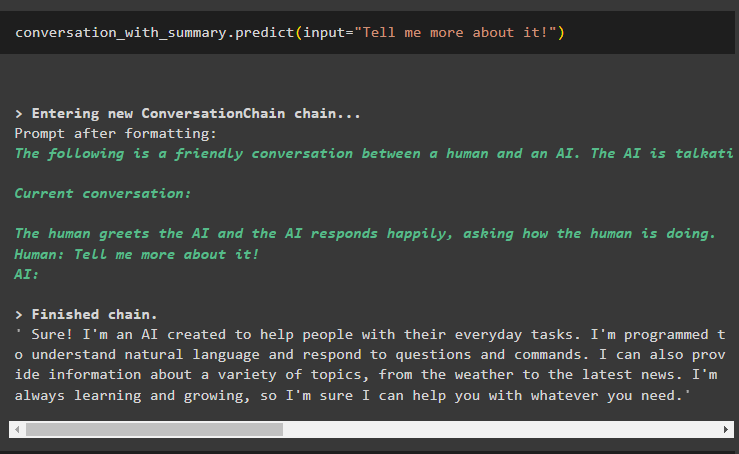

Agora entre na conversa perguntando um pouco mais sobre o último resultado para expandi-lo:

conversa_com_resumo. prever ( entrada = 'Diga-me mais sobre isso!' )O modelo explicou a última mensagem com uma introdução detalhada à tecnologia de IA ou chatbot:

Extraia um ponto de interesse da saída anterior para levar a conversa em uma direção específica:

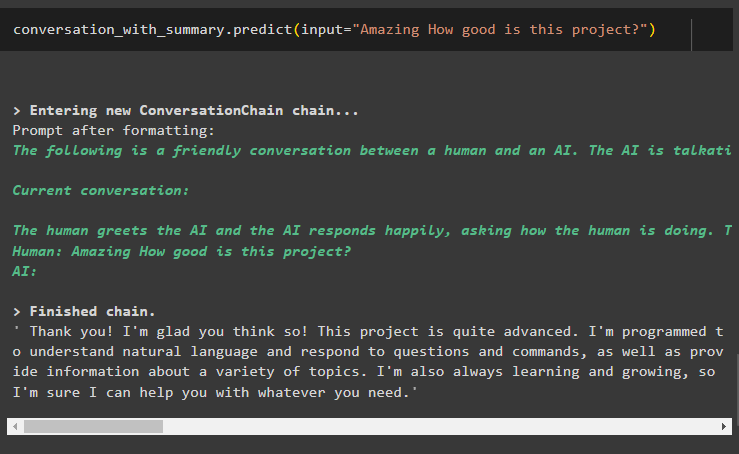

conversa_com_resumo. prever ( entrada = 'Incrível Quão bom é este projeto?' )Aqui estamos obtendo respostas detalhadas do bot usando a biblioteca de memória de resumo de conversas:

Trata-se de usar o resumo da conversa no LangChain.

Conclusão

Para utilizar a mensagem de resumo da conversa no LangChain, basta instalar os módulos e frameworks necessários para configurar o ambiente. Depois que o ambiente estiver definido, importe o ConversaResumoMemória biblioteca para construir LLMs usando o método OpenAI(). Depois disso, basta usar o resumo da conversa para extrair o resultado detalhado dos modelos que é o resumo da conversa anterior. Este guia elaborou o processo de uso da memória de resumo de conversas usando o módulo LangChain.