Esta postagem ilustra o método de uso das funções e classes do analisador de saída por meio da estrutura LangChain.

Como usar o analisador de saída por meio do LangChain?

Os analisadores de saída são as saídas e classes que podem ajudar a obter a saída estruturada do modelo. Para aprender o processo de uso dos analisadores de saída no LangChain, basta seguir as etapas listadas:

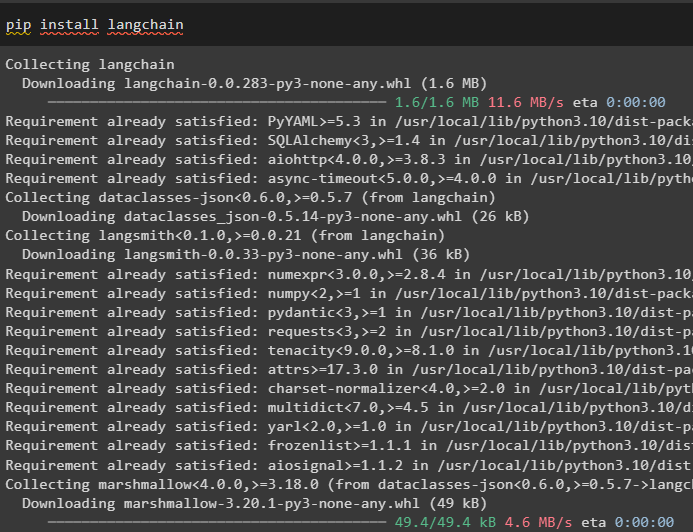

Etapa 1: instalar módulos

Primeiramente, inicie o processo de utilização dos analisadores de saída instalando o módulo LangChain com suas dependências para passar pelo processo:

pip instalar cadeia de idiomas

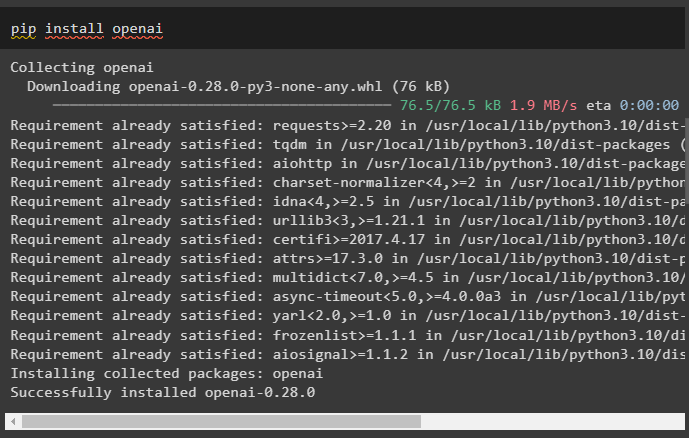

Depois disso, instale o módulo OpenAI para usar suas bibliotecas como OpenAI e ChatOpenAI:

pip instalar aberto

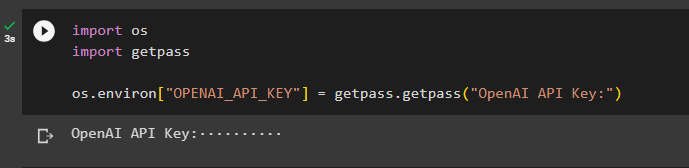

Agora, configure o ambiente para o OpenAI usando a chave API da conta OpenAI:

importe-nos

importar getpass

os.environ [ 'OPENAI_API_KEY' ] = getpass.getpass ( 'Chave de API OpenAI:' )

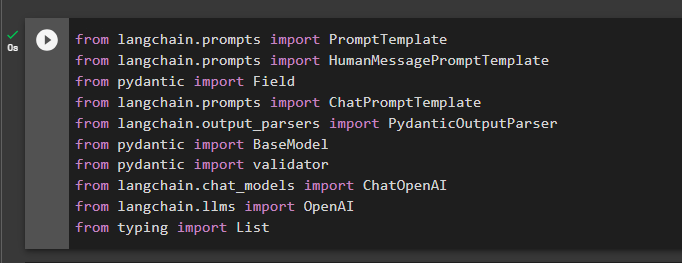

Etapa 2: importar bibliotecas

A próxima etapa é importar bibliotecas do LangChain para usar os analisadores de saída na estrutura:

de langchain.prompts importar HumanMessagePromptTemplate

do campo de importação pydantic

de langchain.prompts importar ChatPromptTemplate

de langchain.output_parsers importar PydanticOutputParser

da importação pydantic BaseModel

do validador de importação pydantic

de langchain.chat_models importar ChatOpenAI

de langchain.llms importar OpenAI

digitando lista de importação

Etapa 3: Construindo Estrutura de Dados

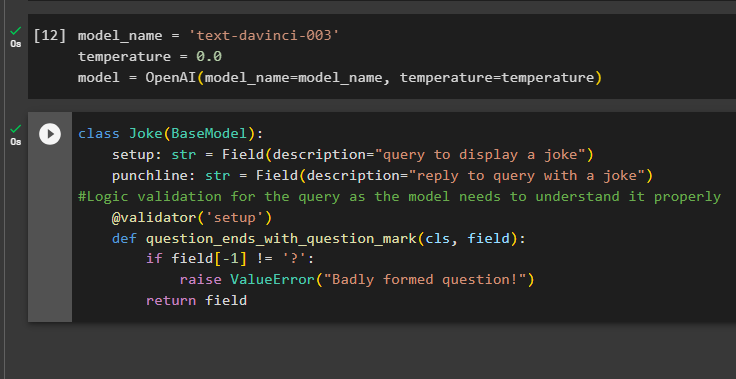

Construir a estrutura da saída é a aplicação vital dos analisadores de saída em modelos de linguagem grande. Antes de chegar à estrutura de dados dos modelos, é necessário definir o nome do modelo que estamos usando para obter a saída estruturada dos analisadores de saída:

temperatura = 0,0

modelo = OpenAI ( nome_modelo =nome_modelo, temperatura =temperatura )

Agora, use a classe Joke que contém o BaseModel para configurar a estrutura da saída para obter a piada do modelo. Depois disso, o usuário pode adicionar facilmente uma lógica de validação personalizada com a classe pydantic, que pode solicitar ao usuário que coloque uma consulta/prompt melhor formada:

piada de classe ( Modelo Base ) :configuração: str = Campo ( descrição = 'consulta para exibir uma piada' )

piada: str = Campo ( descrição = 'responder à pergunta com uma piada' )

#Validação lógica para a consulta, pois o modelo precisa entendê-la corretamente

@ validador ( 'configurar' )

def question_ends_with_question_mark ( cls, campo ) :

se campo [ - 1 ] ! = '?' :

aumentar ValueError ( 'Pergunta mal formulada!' )

retornar campo

Etapa 4: configuração do modelo de prompt

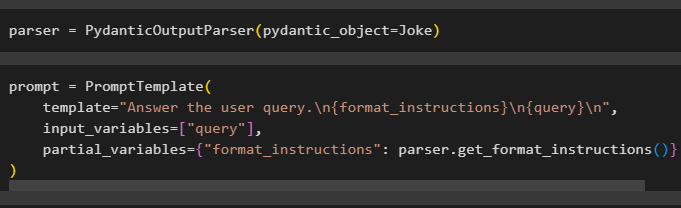

Configure a variável do analisador que contém o método PydanticOutputParser() contendo seus parâmetros:

Após configurar o analisador, basta definir a variável prompt utilizando o método PromptTemplate() com a estrutura da consulta/prompt:

prompt = PromptTemplate (modelo = 'Responda à consulta do usuário. \n {formato_instruções} \n {consulta} \n ' ,

variáveis_de_entrada = [ 'consulta' ] ,

variáveis_parciais = { 'formato_instruções' : parser.get_format_instructions ( ) }

)

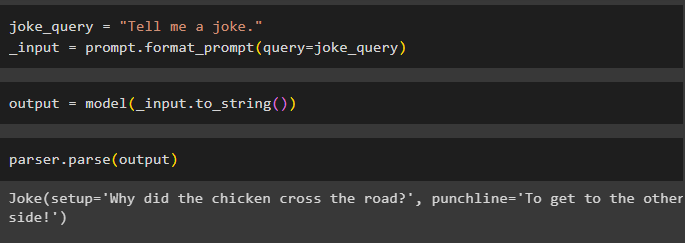

Etapa 5: teste o analisador de saída

Após configurar todos os requisitos, crie uma variável que seja atribuída usando uma consulta e então chame o método format_prompt():

_input = prompt.format_prompt ( consulta = piada_consulta )

Agora, chame a função model() para definir a variável de saída:

saída = modelo ( _entrada.to_string ( ) )Conclua o processo de teste chamando o método parser() com a variável de saída como parâmetro:

analisador.parse ( saída )

Isso é tudo sobre o processo de uso do analisador de saída no LangChain.

Conclusão

Para usar o analisador de saída no LangChain, instale os módulos e configure o ambiente OpenAI usando sua chave API. Em seguida, defina o modelo e em seguida configure a estrutura de dados da saída com validação lógica da consulta fornecida pelo usuário. Depois que a estrutura de dados estiver configurada, basta definir o modelo de prompt e testar o analisador de saída para obter o resultado do modelo. Este guia ilustrou o processo de uso do analisador de saída na estrutura LangChain.