LangChain é a estrutura para construir modelos de chat e LLMs para obter informações do conjunto de dados ou da Internet usando o ambiente OpenAI. O analisador de saída estruturado é usado para obter vários campos ou respostas, como a resposta real e algumas informações extras relacionadas. As bibliotecas do analisador de saída podem ser usadas com LangChain para extrair dados usando os modelos construídos como LLMs ou modelos de chat.

Esta postagem demonstrou o processo de uso do analisador de saída estruturado no LangChain.

Como usar o analisador de saída estruturada em LangChain?

Para usar o analisador de saída estruturado em LangChain, basta seguir estas etapas:

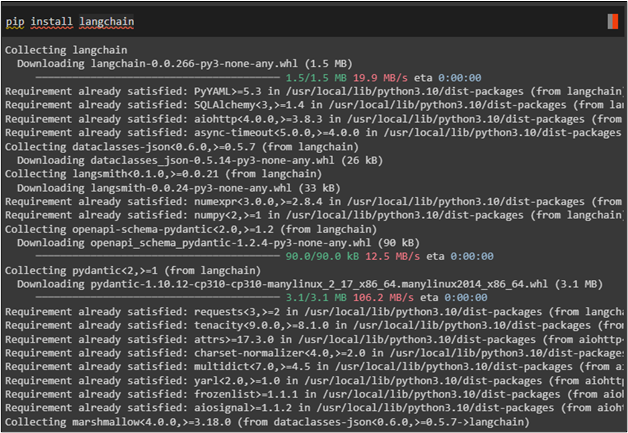

Etapa 1: instalar pré-requisitos

Inicie o processo instalando a estrutura LangChain se ela ainda não estiver instalada em seu ambiente Python:

pip instalar cadeia de idiomas

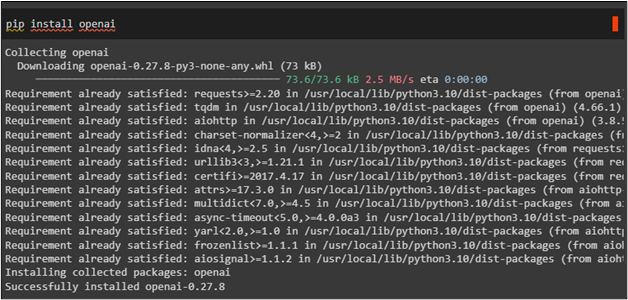

Instale a estrutura OpenAI para acessar seus métodos para construir um analisador em LangChain:

pip instalar aberto

Depois disso, basta conectar-se ao ambiente OpenAI usando sua chave API para acessar seu ambiente usando o “ os ”E forneça a chave API usando o“ Obter passagem ' biblioteca:

importe-nosimportar getpass

os.environ [ 'OPENAI_API_KEY' ] = getpass.getpass ( 'Chave de API OpenAI:' )

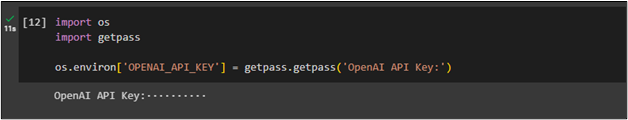

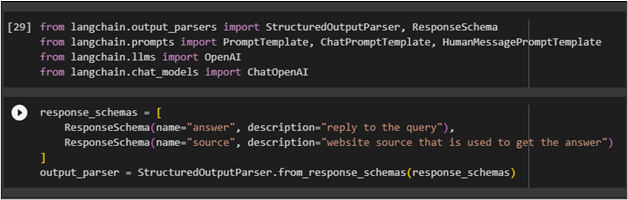

Etapa 2: Construir esquema para saída/resposta

Após obter a conexão com o OpenAI, basta importar as bibliotecas para construir o esquema de geração da saída:

de langchain.output_parsers importar StructuredOutputParser, ResponseSchemade langchain.prompts importar PromptTemplate, ChatPromptTemplate, HumanMessagePromptTemplate

de langchain.llms importar OpenAI

de langchain.chat_models importar ChatOpenAI

Especifique o esquema para a resposta de acordo com o requisito para que o modelo gere a resposta de acordo:

esquemas_resposta = [Esquema de resposta ( nome = 'responder' , descrição = 'responder à consulta' ) ,

Esquema de resposta ( nome = 'fonte' , descrição = 'fonte do site que é usada para obter a resposta' )

]

output_parser = StructuredOutputParser.from_response_schemas ( esquemas_resposta )

Etapa 3: modelo de formato

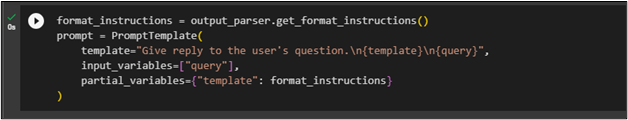

Depois de configurar o esquema para a saída, basta definir o modelo para a entrada na linguagem natural para que o modelo possa entender as perguntas antes de buscar a resposta para ela:

format_instructions=output_parser.get_format_instructions ( )prompt = PromptTemplate (

modelo = 'Responda à pergunta do usuário. \n {modelo} \n {consulta}' ,

variáveis_de_entrada = [ 'consulta' ] ,

variáveis_parciais = { 'modelo' : formato_instruções }

)

Método 1: usando o modelo de linguagem

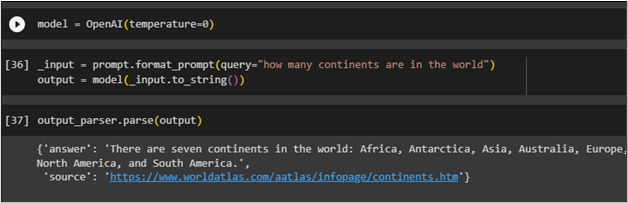

Após configurar os modelos de formato para perguntas e respostas, basta construir o modelo usando a função OpenAI():

modelo = OpenAI ( temperatura = 0 )

Defina o prompt no “ consulta ”variável e passe-a para o formato_prompt() funcionar como entrada e, em seguida, armazenar a resposta no “ saída ' variável:

_input = prompt.format_prompt ( consulta = 'quantos continentes existem no mundo' )saída = modelo ( _entrada.to_string ( ) )

Ligar para analisar() função com a variável de saída como argumento para obter a resposta do modelo:

saída_parser.parse ( saída )

O analisador de saída obtém a resposta para a consulta e exibe uma resposta detalhada com o link para a página do site usada para obter a resposta:

Método 2: usando o modelo de chat

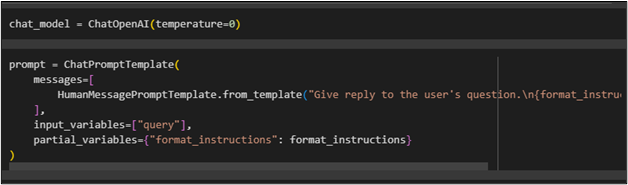

Para obter resultados do analisador de saída em LangChain, use o chat_model variável abaixo:

chat_model=ChatOpenAI ( temperatura = 0 )

Para entender o prompt, configure o modelo de prompt para o modelo de chat. Em seguida, gere a resposta de acordo com a entrada:

prompt = ChatPromptTemplate (mensagens = [

HumanMessagePromptTemplate.from_template ( 'Responda à pergunta do usuário. \n {formato_instruções} \n {consulta}' )

] ,

variáveis_de_entrada = [ 'consulta' ] ,

variáveis_parciais = { 'formato_instruções' : formato_instruções }

)

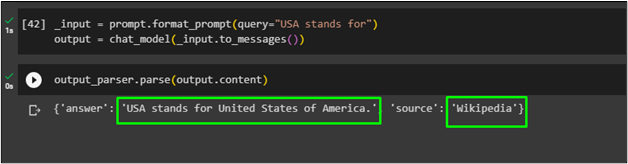

Depois disso, basta fornecer a entrada no campo “ consulta ”variável e depois passá-la para o chat_model() função para obter a saída do modelo:

_input = prompt.format_prompt ( consulta = 'EUA significam' )saída = chat_model ( _input.to_messages ( ) )

Para obter a resposta do modelo de chat, use o output_parser que armazena o resultado do “ saída ' variável:

saída_parser.parse ( saída.content )

O modelo de chat exibia a resposta para a consulta e o nome do site que é utilizado para obter a resposta da internet:

Trata-se de usar um analisador de saída estruturado no LangChain.

Conclusão

Para usar o analisador de saída estruturado no LangChain, basta instalar os módulos LangChain e OpenAI para iniciar o processo. Depois disso, conecte-se ao ambiente OpenAI usando sua chave API e configure os modelos de prompt e resposta para o modelo. O analisador de saída pode ser usado com um modelo de linguagem ou com um modelo de chat. Este guia explica o uso do analisador de saída com ambos os métodos.