LangChain é a estrutura que pode ser usada para importar bibliotecas e dependências para a construção de Large Language Models ou LLMs. Os modelos de linguagem usam memória para armazenar dados ou histórico no banco de dados como observação para obter o contexto da conversa. A memória é configurada para armazenar as mensagens mais recentes para que o modelo possa entender os prompts ambíguos dados pelo usuário.

Este blog explica o processo de uso de memória no LLMChain por meio do LangChain.

Como usar memória no LLMChain por meio do LangChain?

Para adicionar memória e utilizá-la no LLMChain através do LangChain, a biblioteca ConversationBufferMemory pode ser utilizada importando-a do LangChain.

Para aprender o processo de utilização da memória no LLMChain através do LangChain, siga o seguinte guia:

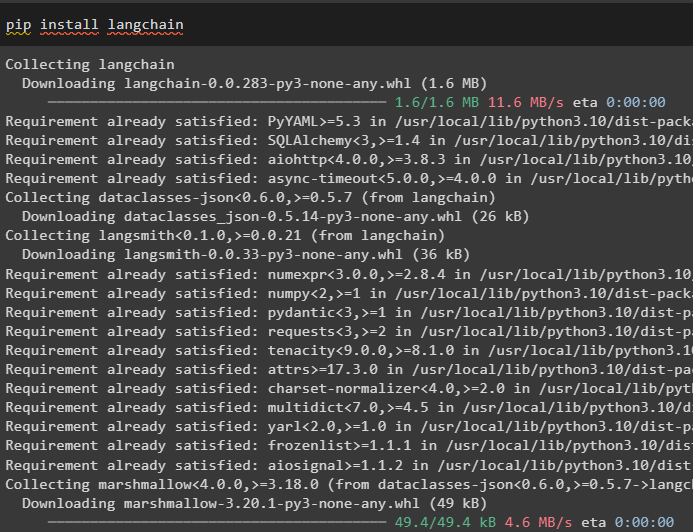

Etapa 1: instalar módulos

Primeiro, inicie o processo de utilização da memória instalando o LangChain usando o comando pip:

pip instalar langchain

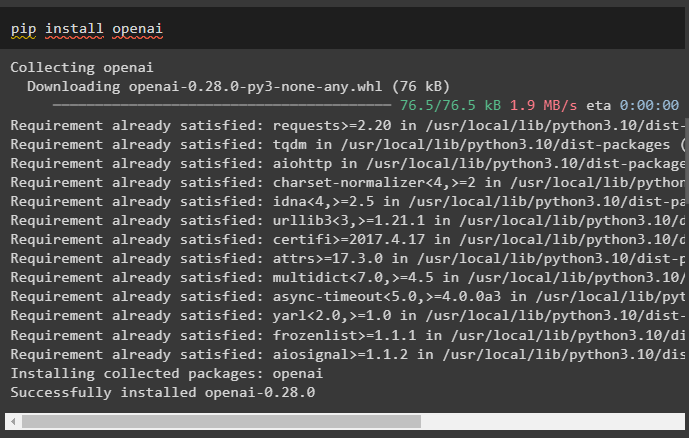

Instale os módulos OpenAI para obter suas dependências ou bibliotecas para construir LLMs ou modelos de chat:

pip instalar openai

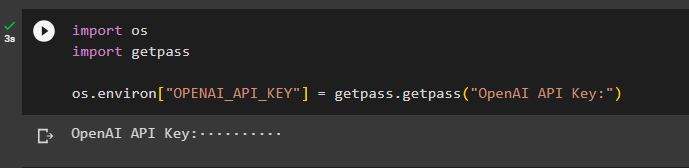

Configure o ambiente para o OpenAI usando sua chave de API importando as bibliotecas os e getpass:

importe-nosimportar getpass

os.environ['OPENAI_API_KEY'] = getpass.getpass('Chave de API OpenAI:')

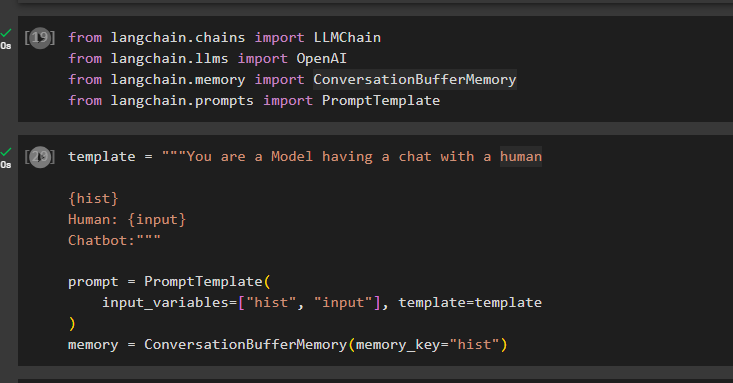

Passo 2: Importando Bibliotecas

Após configurar o ambiente, basta importar as bibliotecas como ConversationBufferMemory do LangChain:

de langchain.chains importar LLMChainde langchain.llms importar OpenAI

de langchain.memory importar ConversationBufferMemory

de langchain.prompts importar PromptTemplate

Configure o template para o prompt usando variáveis como “input” para obter a consulta do usuário e “hist” para armazenar os dados na memória buffer:

template = '''Você é uma modelo conversando com um humano{histórico}

Humano: {entrada}

Bot de bate-papo:'''

prompt = PromptTemplate(

input_variables=['hist', 'input'], modelo=modelo

)

memória = ConversationBufferMemory(memory_key='hist')

Etapa 3: configurar o LLM

Depois que o modelo para a consulta for criado, configure o método LLMChain() usando vários parâmetros:

llm = OpenAI()llm_chain = LLMChain(

lm = lm,

alerta = alerta,

detalhado=Verdadeiro,

memória=memória,

)

Etapa 4: Testando LLMChain

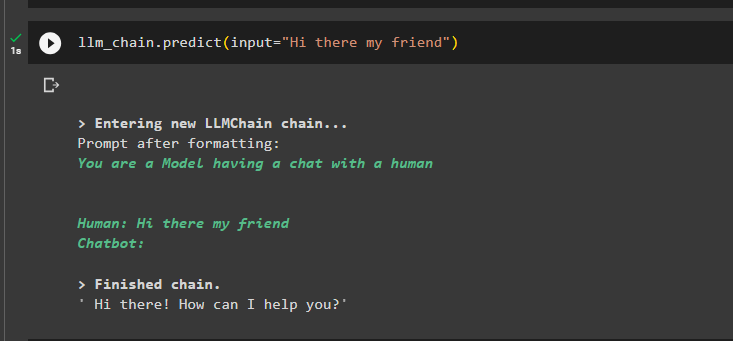

Depois disso, teste o LLMChain usando a variável de entrada para obter o prompt do usuário na forma textual:

llm_chain.predict(input='Olá, meu amigo')

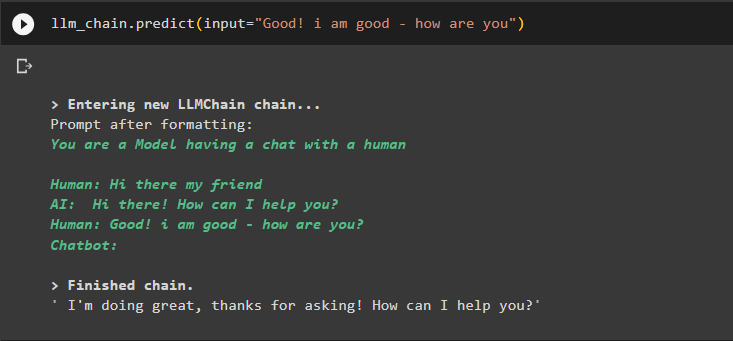

Use outra entrada para obter os dados armazenados na memória para extrair a saída usando o contexto:

llm_chain.predict(input='Bom! Estou bem - como vai você')

Etapa 5: Adicionar memória a um modelo de bate-papo

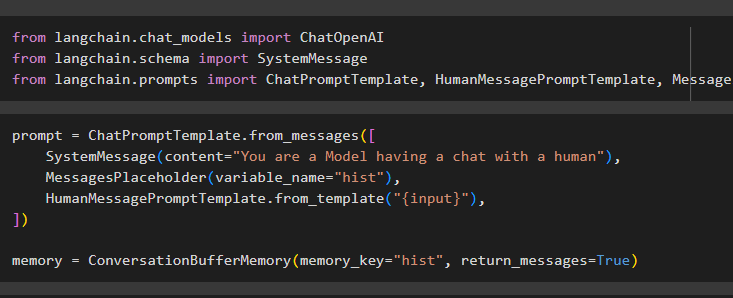

A memória pode ser adicionada ao LLMChain baseado em modelo de chat importando as bibliotecas:

de langchain.chat_models importar ChatOpenAIde langchain.schema importar SystemMessage

de langchain.prompts importar ChatPromptTemplate, HumanMessagePromptTemplate, MessagesPlaceholder

Configure o modelo de prompt usando ConversationBufferMemory() usando diferentes variáveis para definir a entrada do usuário:

prompt = ChatPromptTemplate.from_messages([SystemMessage(content='Você é uma modelo conversando com um humano'),

MensagensPlaceholder(variable_),

HumanMessagePromptTemplate.from_template('{entrada}'),

])

memória = ConversationBufferMemory(memory_key='hist', return_messages=True)

Etapa 6: configurando o LLMChain

Configure o método LLMChain() para configurar o modelo usando diferentes argumentos e parâmetros:

llm = ChatOpenAI()chat_llm_chain=LLMChain(

lm = lm,

alerta = alerta,

detalhado=Verdadeiro,

memória=memória,

)

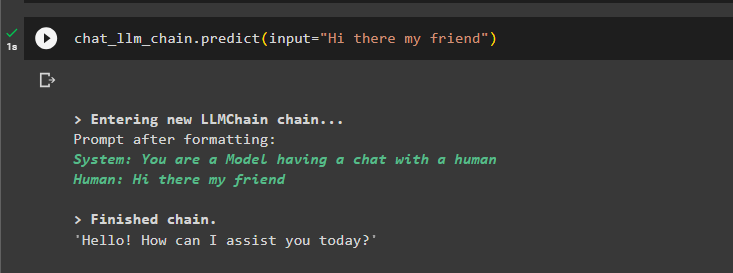

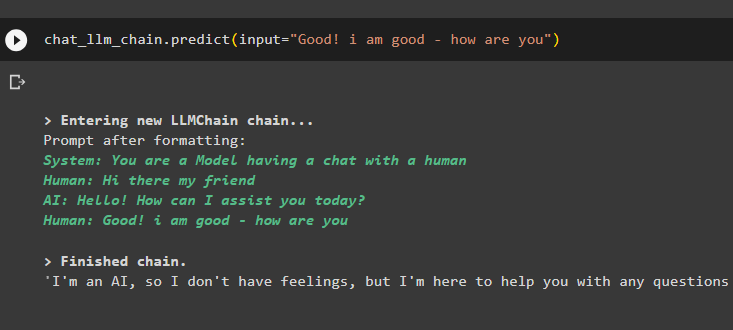

Etapa 7: Testando LLMChain

Ao final, basta testar o LLMChain utilizando o input para que o modelo possa gerar o texto de acordo com o prompt:

chat_llm_chain.predict(input='Olá, meu amigo')

O modelo armazenou a conversa anterior na memória e a exibe antes da saída real da consulta:

llm_chain.predict(input='Bom! Estou bem - como vai você')

Trata-se de usar memória no LLMChain usando LangChain.

Conclusão

Para utilizar a memória do LLMChain através do framework LangChain, basta instalar os módulos para configurar o ambiente para obter as dependências dos módulos. Depois disso, basta importar as bibliotecas do LangChain para utilizar a memória buffer para armazenar a conversa anterior. O usuário também pode adicionar memória ao modelo de chat construindo o LLMChain e depois testando a cadeia fornecendo a entrada. Este guia elaborou o processo de uso da memória no LLMChain por meio do LangChain.