Sintaxe:

Diferentes funções se enquadram no Processamento de Linguagem Natural para a incorporação de palavras no texto. Este artigo aborda a função “word2vec” para esta finalidade. Para tornar mais claro, a incorporação de palavras converte nossas entradas de texto na representação vetorial, onde as palavras que têm mais ou menos os mesmos significados contextuais deram a mesma representação.

O algoritmo “word2vec” é um modelo de rede neural que é treinado de forma a aprender a incorporação das palavras, primeiro prevendo o contexto da palavra em que ela aparece. Este modelo recebe o texto como entrada. Então, para cada palavra no texto, a representação vetorial é criada para aquela palavra. Este modelo baseia-se na ideia de que as palavras que parecem ter o mesmo contexto têm os mesmos significados. A sintaxe para “word2vec” é a seguinte:

$ Word2Vec(frases, min_count)

Este algoritmo tem dois parâmetros que são “sentences” e “minimum_count”. A sentença é a variável onde a lista de sentenças ou o texto na forma de sentenças é armazenado e o Minimum_count fala sobre o valor de contagem de 1 o que significa que qualquer uma das palavras no texto que apareceu menos que um precisa ser ignorada .

Exemplo 1:

Neste exemplo, criamos a palavra embeddings para as palavras que existem na lista de frases em inglês. Para criar a palavra “embedding”, precisamos usar o modelo “word2vec”. Este modelo é um pacote da biblioteca “gensim” do Python. Precisamos ter o Gensim instalado em nossos repositórios de bibliotecas Python para trabalhar com “word2vec”.

Para implementar este exemplo, trabalharemos no compilador Python online “google colab”. Para instalar o gensim, use o comando “pip install gensim”. Isso inicia o download desta biblioteca com todos os seus pacotes associados. Uma vez instalado, basta importar o pacote “word2vector” do gensim.

Para treinar esse modelo “word2vec”, precisamos criar um conjunto de dados de treinamento. Para isso, criamos uma lista de frases que contém de quatro a cinco frases em inglês. Salvamos esta lista na variável “training_data”.

Nosso próximo passo depois de criar o conjunto de dados de treinamento é treinar o modelo “word2vec” nesses dados. Então, chamamos o modelo. Damos os dados de treinamento nos parâmetros de entrada deste modelo que salvamos na variável “input”. Em seguida, especificamos o segundo parâmetro que é o “minimum_count”. Definimos seu valor igual a “1”. A saída desse modelo de treinamento é salva na variável “modelo_treinado”.

Assim que terminarmos de treinar o modelo, podemos simplesmente acessar o modelo com o prefixo “wv”, que é a palavra modelo vetorial. Também podemos acessar o vocabulário do token de nossas palavras e imprimi-las com o método a seguir:

vocabof_tokens = lista (model.wv.vocab)O modelo representa o modelo treinado em nosso caso. Agora, acessamos a representação vetorial de uma palavra da lista da frase que, no nosso caso, é “maçã”. Fazemos isso simplesmente chamando o modelo treinado. Passamos a palavra cuja representação vetorial queremos imprimir como “model. wv ['apple']” ao seu argumento de entrada. Em seguida, imprimimos os resultados com a função “print”.

de como uma nação modelos importar Word2Vecdados_de_treinamento = [ [ 'maçã' , 'é' , 'o' , 'doce' , 'maçã' , 'para' , 'palavra2vec' ] ,

[ 'esse' , 'é' , 'o' , 'segundo' , 'maçã' ] ,

[ 'aqui' , 'outro' , 'maçã' ] ,

[ 'um' , 'doce' , 'maçã' ] ,

[ 'e' , 'mais' , 'doce' , 'maçã' ] ]

modelo = Word2Vec ( dados_de_treinamento , min_count = 1 )

imprimir ( modelo )

vocabof_tokens = lista ( modelo. wv . index_to_key )

imprimir ( vocabof_tokens )

imprimir ( modelo. wv [ 'maçã' ] )

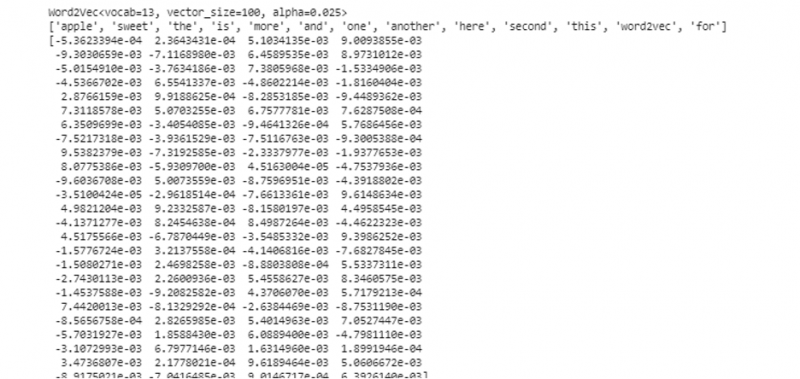

A partir da saída e do código mencionados anteriormente, a palavra embedding para a palavra “apple” é mostrada. No exemplo, primeiro criamos um conjunto de dados de treinamento. Em seguida, treinamos um modelo nele e resumimos o modelo. Então, usando o modelo, temos acesso ao vocabulário token das palavras. Depois disso, exibimos a palavra incorporação para a palavra “apple”.

Exemplo 2:

Usando a biblioteca gensim, vamos criar outra lista de sentenças. Treine nosso modelo para cada palavra na frase para criar a incorporação de palavras usando o modelo “word2vec”. Primeiro, do pacote da biblioteca gensim, o modelo “word2vec” é importado. Em seguida, criamos outro conjunto de dados que será a lista que contém as duas frases. Cada frase na lista tem quatro palavras.

Agora, salvamos esta lista na variável “data”. Então, chamamos o modelo “word2vec()” e alimentamos os dados para os argumentos deste modelo com o valor Minimum_count que é igual a “1”. É assim que treinamos nosso modelo. Agora, ele é capaz e pode aprender o word embedding das palavras que existem nas frases que estão presentes na lista, prevendo o contexto em que elas existem. Para testar os resultados de nosso modelo, simplesmente passamos uma palavra como “cachorro” em nossos dados para o modelo. Em seguida, imprimimos os resultados usando a função “print()”.

de como uma nação modelos importar Word2Vecdados = [ [ 'coelho' , 'tem' , 'dentes' ] , [ 'cachorro' , 'tem' , 'ouvidos' ] ]

modelo = Word2Vec ( dados , min_count = 1 )

imprimir ( modelo. wv [ 'cachorro' ] )

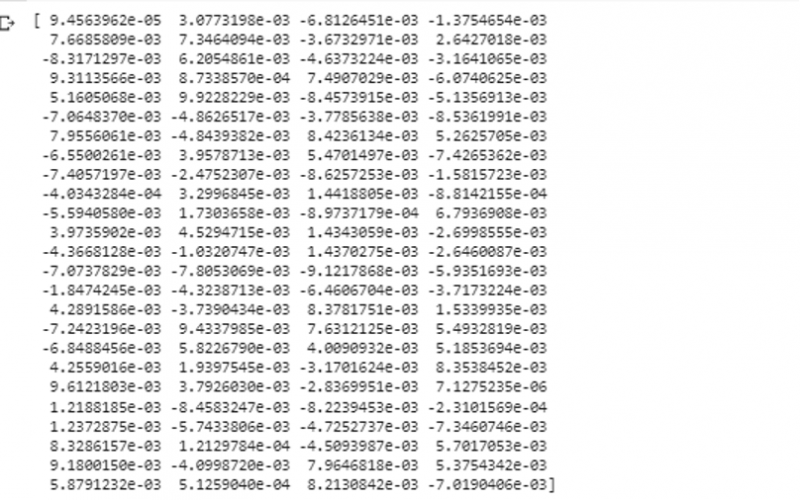

Podemos observar a representação vetorial da palavra que alimentamos o modelo como sua entrada do trecho anterior da saída.

Conclusão

Este guia demonstra o método para criar a incorporação de palavras para as palavras que existem na lista de frases em inglês. Aprendemos sobre a biblioteca “gensim” do Python que fornece o modelo “word2vec” para criar a incorporação de palavras. Além disso, aprendemos sobre parâmetros de entrada, como treinar o modelo “word2vec” nos dados de treinamento e como apresentar a palavra em uma representação do vetor.